欧洲议会于2023 年 6 月14日以 499 票赞成、28 票反对、93 票弃权的结果通过了人工智能 (AI) 法案的草案,随后与欧盟成员国会就该法案的最终形式进行谈判,目标是在今年年底前达成共识协议。这些规范将确保欧洲开发及使用的人工智能能完全符合欧盟的权利和价值观,包括人类监督、安全、隐私、透明度、非歧视以及社会和环境福祉。

乍看之下欧盟人工智能法案和我们关系有点遥远,其实不然。因为新规范除了适用于在欧盟境内的人工智能系统供货商之外,还适用于在第三国设立,但于欧盟市场或欧盟提供或使用其人工智能系统的供货商。为了防止厂商规避法规,新规范也适用于身处第三国的人工智能系统供货商和用户,而这些系统所产出的成品会在欧盟使用。在此规范下,欧盟人工智能法案变得与各国厂商息息相关,加上中国对于人工智能的产出及应用也将进入监管的阶段,我们对欧盟于人工智能的监管方针,也应多加了解。

图片来源 : shutterstock、达志影像

立法进程及法案草案概观

欧盟委员会 (European Commission,以下简称委员会)于 2021 年 4 月提出了欧盟人工智能 (AI) 监管框架提案,而这一份人工智能法案草案是有史以来首次尝试对人工智能制定水平式横向监管规范。委员会拟议的法律框架侧重于人工智能系统的特定应用和相关风险,提议在欧盟法律中为人工智能系统建立一个技术中立定义,并根据「基于风险的取向」(risk-based approach)制定具有不同要求和义务的人工智能系统分类。一些存在「无法接受」风险的人工智能系统将被禁止。其外,各种「高风险」的人工智能系统将会被授权,且要遵守一系列要求和义务才能进入欧盟市场。那些仅呈现「有限风险」的人工智能系统将受低透明度的义务约束。欧盟理事会于 2021 年 12 月同意了欧盟成员国的整体立场,其后,欧洲议会于 2023 年 6 月14日对其立场进行了投票并获得通过。欧盟立法部门目前开始以谈判方式敲定新法案,并对委员会的提案进行实质性修改,包括修改人工智能系统的定义、扩大被禁止的人工智能系统列表,并对通用人工智能和生成人工智能模型(如ChatGPT)赋予义务。

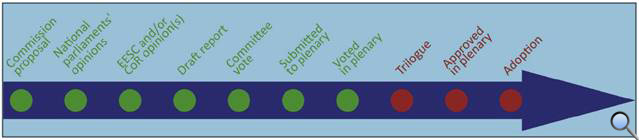

图1. 欧盟人工智能法案立法进程

图片来源:Artificial intelligence act BRIEFING,EU Legislation in Progress,EPRS |

European Parliamentary Research Service,June 2023

注:此为截至2023年6月为止欧盟人工智能法案立法进程,绿色部分为已完成,而红色部分则希望于2023年底前达成

提案简介

人们预料人工智能技术将于环境与健康、公共部门、金融、交通、内政和农业……等等多个领域带来广泛的经济和社会效益;特别是在精进预测、优化营运、资源分配以及个性化服务等区块。然而,当人工智能技术嵌入到产品及服务中时,人工智能系统对《欧盟基本权利宪章》(EU Charter of Fundamental Rights) 保护的基本权利带来的影响,以及人工智能系统使用时给用户带来的安全风险,已开始引起人们的关注。最值得注意的是,人工智能系统可能会危害人民基本权利,例如不受歧视的权利、言论自由、人类尊严、个人数据保护和隐私等等。

鉴于人工智能相关技术的快速发展,近年来人工智能监管已成为欧盟的核心政策问题。政策制定者承诺制定「以人为中心」(humancentric) 的人工智能手段,以确保欧洲民众能够从依据欧盟价值观和原则开发及运作的新技术中受益。在其欧盟2020 年人工智能白皮书中(2020 White Paper on Artificial Intelligence),欧盟委员会承诺促进人工智能的采用,并解决伴随应用这项新技术而来的一些相关风险。虽然委员会最初采取了软法律方法,并发布了不具法律约束力的 《2019值得信赖的人工智能及政策道德准则》 (2019 Ethics Guidelines for Trustworthy AI and Policy),以及投资建议,但随后转向了立法方式,呼吁采用统一的规范来监管人工智能系统的开发、投入市场及使用。

全球人工智能监管手段

尽管美国最初对人工智能采取了宽松的态度,但最近要求监管的呼声越来越高。中国国家互联网信息办公室也在咨询一项监管人工智能的提案,而英国则正在制定一套有利于创新的监管原则。在国际层面,经济合作与发展组织(OECD)于 2019 年通过了一项关于人工智能的(无法律约束力)建议书、联合国教科文组织 (UNESCO) 于 2021年通过了关于人工智能伦理的建议书、欧洲委员会目前正在制定一项关于人工智能的国际公约。此外,在新建立的「欧盟-美国」技术伙伴关系(贸易和技术理事会)的背景下,欧盟和美国正在就强调可信赖及负责任的人工智能的原则寻求共识。欧盟立法委员于2023年5月发表联合声明,敦促拜登总统和欧盟委员会主席乌尔苏拉·冯德莱恩召开峰会,寻找控制ChatGPT等先进人工智能系统发展的方法。 |

欧洲议会的立场

欧洲议会在 2017 年关于机器人民法规范的广泛建议中,引领了欧盟层面的辩论,呼吁欧盟委员会评估人工智能的影响,并起草欧盟人工智能框架。在2020年和2021年,欧洲议会通过了多项呼吁欧盟采取行动的非立法决议,以及两项呼吁在人工智能领域通过欧盟立法的立法决议。第一项立法决议要求委员会为欧盟内人工智能、机器人和相关技术的开发、部署和使用建立道德原则的法律框架。第二项立法决议呼吁协调民事责任索赔的法律框架,并对高风险人工智能系统的营运商实行严格责任制度。此外,议会还通过了一系列建议,呼吁欧盟在知识产权、刑法、教育、文化和视听领域,以及民用和军用人工智能应用方面,对人工智能采取共同手段。

欧盟理事会角色

欧盟理事会 (Council of the European Union) 在过去(包括在 2017 年和 2019 年)曾多次呼吁采用通用人工智能规则。理事会在2020年呼吁委员会提出具体建议,并在考虑现有立法基础下,遵循一个建基于风险、平衡、以及必要的监管方法。此外,理事会呼吁欧盟和成员国考虑采取有效措施来识别、预测和应对包括人工智能在内的数字技术对基本权利的潜在影响。

继 2020 年 2 月通过人工智能白皮书后,委员会于2020年启动了广泛的公众咨询,并发布了人工智能监管影响评估、支持性研究和提案草稿,并收到了各方利益关系人的反馈。在其影响评估中,委员会指出人工智能系统由于其具体特征,在开发和使用时所引发的几个问题。

草案带来的影响

人工智能法案草案被设计成为欧盟水平横向立法指引,适用于所有在欧盟市场中投放、或被使用的人工智能系统。

● 目的、法律依据和范围

2021 年 4 月公布的人工智能法案提案的总体目标是为欧盟内开发和使用值得信赖的人工智能系统创造条件,以确保单一市场的正常运作。该草案为人工智能产品和服务的开发、投放到欧盟市场以及使用,制定了统一的法律框架。此外,人工智能法案提案力求实现一系列具体目标,包括(i)确保投放到欧盟市场的人工智能系统安全并尊重现有欧盟法律,(ii)确保法律确定性以促进人工智能投资和创新, (iii) 加强对适用于人工智能系统的基本权利和安全要求的欧盟法律的治理和有效执行,以及 (iv) 促进合法、安全和值得信赖的人工智能应用的单一市场发展,并防止市场碎片化。

新的人工智能框架基于《欧盟运作条约》(TFEU)第 114条和第16条,会对人工智能系统进行技术中立的定义,并采取基于风险的方式,在于欧盟开发、市场投放和使用人工智能系统方面赋予了不同的义务及需求规定。在实践中,该提案定义了适用于人工智能系统在投放市场之前的设计和开发的通用性强制要求,并协调了事后控制的实施方式。

人工智能法案提案补充了现有和即将出台的横向和部门性欧盟安全法规。委员会建议遵循新立法框架 (NLF) 的逻辑,即当产品进入欧盟市场时,欧盟必须确保该系列产品通过合格评定和有合规的CE标志。

新规范主要适用于在欧盟境内的人工智能系统供货商,或在第三国设立,但于欧盟市场或欧盟提供或使用其人工智能系统的供货商,以及身处欧盟成员国的人工智能系统用户。为了防止厂商规避法规,新规则也适用于身处第三国的人工智能系统供货商和用户,而这些系统所产出的成品会在欧盟被使用。但是,该法规草案不适用于专门为军事目的、第三方国家公部门、国际组织、或在国际执法和司法合作协议框架内使用人工智能系统的局方开发或使用的人工智能系统。

● 定义

目前科学界对人工智能的单一定义并没有共识,「人工智能」一词经常被用作基于不同技术的各种计算机应用程序的「统称术语」。人工智能高水平专家组 (High Level Expert Group) 提出了人工智能的基线定义,该定义在科学文献中的使用率日增,联合研究中心也基于分类法建立了人工智能的操作性定义,该分类法涵盖了政治、研究和工业领域的所有人工智能子领域。

然而,委员会发现,鉴于确定「人工智能系统」的构成对于新人工智能框架下的法律责任分配至关重要,因此应该对人工智能系统的概念进行更明确的定义。因此,委员会建议在欧盟法律中建立「人工智能系统」的法律定义,该定义主要基于经合组织 (OECD) 已经使用的定义。

草案第 3 条第(1)款规定,「人工智能系统」是指:

...使用[特定]技术和方法 [在附件1中列出] [1]开发的软件,可以针对一组给定的人类定义的目标,生成影响其交互环境的内容、预测、建议或决策等输出结果。

此外,第 3 条提供也了其他相关定义,包括人工智能系统的「提供者」和「用户」(涵盖公共和私人实体),以及「进口商」和「分销商」、「情感识别」和「人工智能系统」,以及「生物识别分类」。

「基于风险的取向」(risk-based approach)

● 风险金字塔

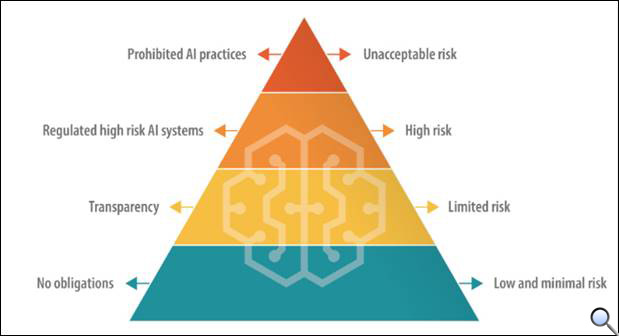

人工智能的使用具有其特定的特征(例如不透明、复杂性、对数据的依赖、自主行为),可能会对许多基本权利和用户的安全产生不利影响。为了解决这些问题,人工智能法案草案遵循基于风险的方法,即根据具体的风险水平进行法律干预。为此,人工智能法案草案区分了具有以下4个层级风险的人工智能系统:(i) 无法接受的风险、(ii) 高风险、(iii) 有限风险和 (iv) 低风险或极小风险 (图2)。人工智能应用程序只会在严格必要的情况下受到监管。

图2. 人工智能监管框架草案 (风险金字塔)

数据源:European Commission

● 无法接受的风险:禁止实践的人工智能

人工智能法案草案第二章(第 5 条)明确禁止有害的人工智能实践,因为造成了「无法接受的风险」,故 被认为对人民的安全、生计和权利构成明显威胁;因此,禁止在欧盟市场投放、投入服务或使用,具体包括:

人工智能系统采用有害的操纵性「潜意识技术」; 人工智能系统采用有害的操纵性「潜意识技术」;

利用特定弱势群体(身体或精神残疾)的人工智能系统; 利用特定弱势群体(身体或精神残疾)的人工智能系统;

公部门或代表公部门使用的人工智能系统,用于社会评分目的; 公部门或代表公部门使用的人工智能系统,用于社会评分目的;

出于执法目的,在公共场所使用「实时」远程生物特征识别系统,但少数情况除外。 出于执法目的,在公共场所使用「实时」远程生物特征识别系统,但少数情况除外。

● 高风险:受监管的高风险人工智能系统

人工智能法案草案第三章(第 6 条)监管对人们的安全或基本权利造成不利影响的「高风险」人工智能系统。该草案文本区分了两类高风险人工智能系统。

用作产品安全组件或受欧盟健康和安全协调立法管辖的系统(例如玩具、航空、汽车、医疗设备、电梯)。 用作产品安全组件或受欧盟健康和安全协调立法管辖的系统(例如玩具、航空、汽车、医疗设备、电梯)。

部署在附件三确定的8个具体领域的系统 (如下),委员会可以根据需要通过授权行为更新这些系统(第 7 条): 部署在附件三确定的8个具体领域的系统 (如下),委员会可以根据需要通过授权行为更新这些系统(第 7 条):

(1) 自然人的生物特征识别和分类;

(2) 关键基础设施的管理和营运;

(3) 教育和职业培训;

(4) 就业、工人管理和迈入自营业;

(5) 获得和享受基本私人服务、以及公共服务和福利;

(6) 执法;

(7) 移民、庇护和边境管制管理;

(8) 司法和民主程序。

所有这些高风险人工智能系统都将受到一系列新规则的约束,包括:

事前合格评定的要求:高风险人工智能系统的供货商在将产品于欧盟市场推出或投入使用前,需要在欧盟委员会管理的欧盟范围内的数据库中注册其系统。任何受现有产品安全立法管辖的人工智能产品和服务,都将属于已适用的现有第三方合规框架(例如医疗设备)。目前不受欧盟立法管辖的人工智能系统供货商必须进行自己的合格评定(自我评估),以表明他们符合新要求,并可以使用 CE 标志。只有用于生物识别的高风险人工智能系统才需要由「公告机构」进行合格评定。

其他要求:此类高风险人工智能系统必须遵守一系列要求,特别是在风险管理、测试、技术稳健性、数据培训和数据治理、透明度、人类监督和网络安全方面的要求(第 8 至 15 条)。在这方面,高风险人工智能系统的供货商、进口商、分销商和用户必须履行一系列义务。来自欧盟以外的供货商将要求欧盟境内的授权代表确保合格评定、建立上市后监控系统,并根据需要采取纠正措施。

面部识别的风险度

人工智能支持生物识别技术的使用,包括面部识别技术(Facial Recognition Technology,FRT),于私人或公共行为将其用于验证、识别和分类目的。除了现有的适用立法(例如数据保护和非歧视)外,人工智能法案草案还提议为 FRT 引入新规则,并根据其「高风险」或「低风险」使用特征对其进行区分。禁止在公共空间出于执法目的使用实时面部识别系统,除非成员国出于重要的公共安全原因选择授权这些系统,并授予适当的司法或行政授权。但可以允许用于执法以外目的(例如边境管制、市场、公共交通甚至学校)的各种 FRT,但在进入欧盟市场之前必须经过合格评定并遵守安全要求。 |

● 有限风险:透明度义务

呈现「有限风险」的人工智能系统,例如与人类交互的系统(即聊天机器人)、情感识别系统、生物识别分类系统以及生成或操纵图像、音频或视频内容(即深度伪造,deepfakes)的人工智能系统,将受到一系列有限的透明度义务。

● 低或最小风险:无义务

所有其他较低或最小风险的人工智能系统都可以在欧盟开发和使用,而无需遵守任何额外的法律义务。然而,人工智能法案草案设想制定行为准则,以鼓励非高风险人工智能系统的提供者自愿适用高风险人工智能系统的强制性要求。

参考数据:

- Artificial intelligence act BRIEFING,EU Legislation in Progress,EPRS | European Parliamentary Research Service,June 2023

- Regulatory framework proposal on artificial intelligence, European Commission, Last update 20 June 2023

备注:

- 该草案的附件 1 列出了目前用于开发人工智能的技术和方法列表。因此,「人工智能系统」的概念将指一系列基于软件的技术,包括「机器学习」、「基于逻辑和知识的」系统以及「统计」方法。这一广泛的定义涵盖了可以独立使用或作为产品组件使用的人工智能系统。此外,拟议的立法旨在面向未来,涵盖当前和未来的人工智能技术发展。为此,委员会将通过采用授权法案,通过用于开发人工智能系统的新方法和技术来补充附件 1 列表(第 4 条)。

好消息~北美智权报有微信公众号了!

《北美智权报》内容涵盖世界各国的知识产权新闻、重要的侵权诉讼案例分析、法规解析,以及产业与技术新知等等。

立即关注北美智权微信公众号→ NAIP_IPServices

~欢迎读者分享与转发~ |

|

|

| 作者: |

李淑莲 |

| 现任: |

北美智权报主编 |

| 学历: |

(台湾)文化大学新闻研究所 |

| 经历: |

半导体科技杂志(SST-Taiwan)总编辑

CompuTrade International总编辑

日本电波新闻 (Dempa Shinbun) 驻海外记者

日经亚洲电子杂志 (台湾版) 编辑 |

|

|

|