|

图片来源 : shutterstock、达志影像

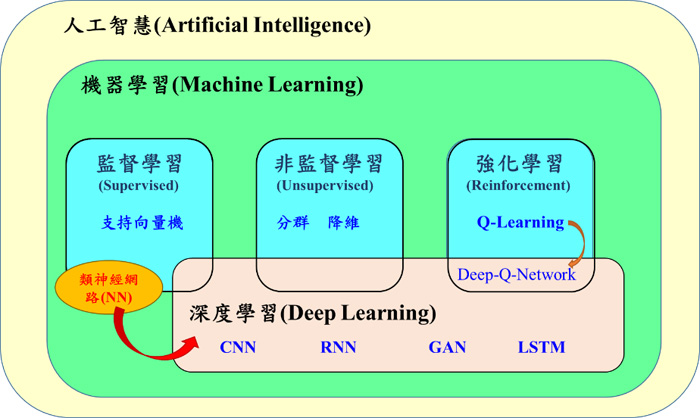

第三次AI浪潮所兴起的机器学习有许多种手法,最受瞩目的就是深度学习。然而,深度学习只是由监督式学习下的类神经网络 (Neural Network, NN) 所演化出来的,经过这几年不断的演化,已从只能处理监督式学习问题扩展到非监督式和强化学习,人工智能、机器学习和深度学习彼此间之关系及其演进如图1所示。

图1. 人工智能、机器学习和深度学习之关系及其演进

图片来源:芮嘉玮改编绘制

因此,类神经网络(NN)是深度学习的基础,简言之,它是一种模仿人脑神经组织(又称神经元)数学模型化的机制。目前AI芯片的发展则多半在处理深度学习类型的问题,而非处理传统机器学习及真正人工智能的问题。为了了解深度学习芯片或神经网络(NN)芯片的运作,得先了解组成「神经网络 (NN)」之神经元结构及其工作原理。

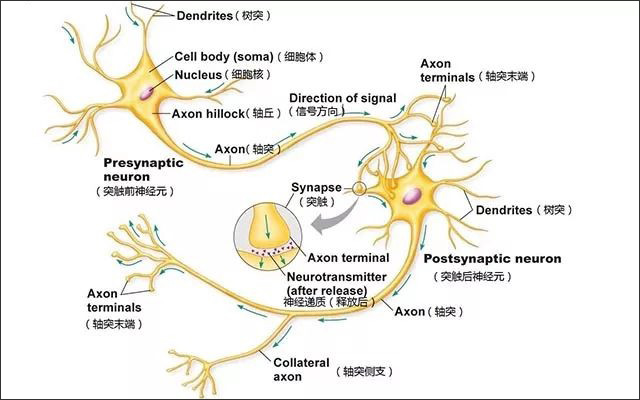

神经元 (neuron),又名神经细胞 (nerve cell),是神经系统的结构与功能单位之一,其结构如图2所示。人脑的活体神经细胞包括突触 (Synapses)、树突 (Dendrites)、细胞体 (Cell Body) 和轴突 (Axon)等四个主要功能组成,其相互运作关系及功能简述如下:

- 细胞体 (cell body):由细胞质基质、细胞器和细胞核组成,故细胞核位于其中。细胞体是神经元蛋白质合成的主要场所,其运作系由此发出突起,树突 (dendrites) 伸展到周围的神经组织,从突触中收集脉冲,并将脉冲传回神经元的心脏,此即细胞体运作功能。

- 树突 (Dendrites):是一群由细胞体发出多分支的树状突起,它可以是神经元的输入信道,其功能是将自其他神经元所接收的动作电位 (电信号) 传送至细胞本体;树突也可以是神经元的讯息接收站,因与其他神经元的轴突 (Axon) 连接而把传入的讯息送至神经元的本体。

- 突触 (Synapses):讯号权重神经元和神经元相接处即称为突触 (synapse),因此是神经元之间通信的特异性接头 (junction),其分散在树突树根状纤维的表面上,依讯号传递的方向则可将神经元分为「突触前神经元 (presynaptic neuron)」与「突触后神经元 (postsynaptic neuron)」。神经元之间的突触可以分为化学突触 (chemical synapse)和电突触 (electrical synapse)两大类。

- 轴突 (Axon):即神经细胞之细胞体长出突起。大量轴突牵连一起,以其外型类似而称为神经纤维。于神经系统中,轴突是主要神经信号传递的渠道,功能为将细胞体之动作电位 (电信号或称输出脉冲) 传导到神经组织,最终传导至在其他细胞之树突上末端的突触 (synapse)。

图2. 典型神经元的结构[1]

照片来源:《解析目前六款类脑芯片,如何颠覆传统架构》,Chang, Hung-Yang,Oct 4, 2018

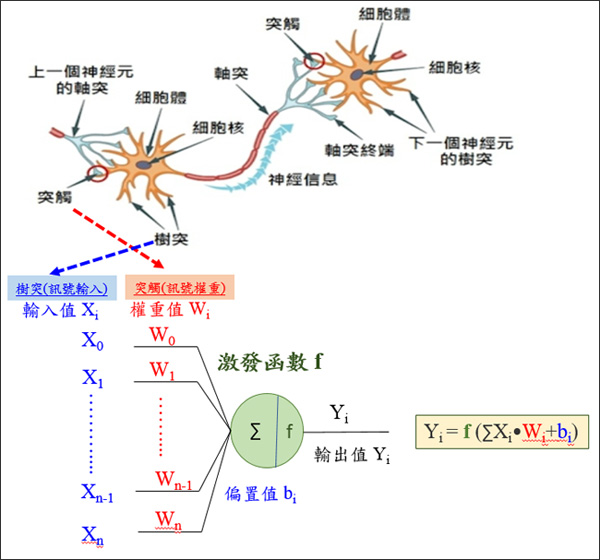

类神经网络的工作原理即仿真人脑的神经突触传递结构,透过脉冲传递讯息。神经元之间的每个连接可将信号传递给另一个神经元,处理信号的方式系透过树突向连接到它的下游神经元发出信号,突触具有随学习进行而变化的权重,这可增加或减小它发送到下游的信号的强度。此外,它们可具有阈值 (threshold),使得只有在总信号低于或高于该阈值门坎时才发送信号到下游。每个神经元都与各种输入相连,一些输入在神经元中产生激发,而另一些输入则抑制它,如人工神经网络中的正负权重。如图3所示,每个神经元有n个输入值,例如X0, X1, ……., Xn-1, Xn,而每个输入值有一个权重(Weight)值,例如W0, W1, ……..Wn-1, Wn,把所有(输入值Xi)乘以(权重值Wi)加总起来,有时会另外加上一个偏置值(bi)来调整,将得到的值再经过一个激发函数 (Activation function) 即可产生新的输出值Yi,并以Yi = f (∑Xi•Wi+bi)的式子表示。以图3为例,由左至右为推论 (Inference),可获得输出结果,过程中需要n个权重值Wi加上1个偏置值bi,而这些值是需要经由训练 (Training) 取得的。训练前须取得许多(越多越好)已知答案或称为标签 (Label) 的训练数据,如果第一组输入数据已知答案为(1.0),但经过推论后只得到0.7,则表示权重及偏置值不理想而需要调整,此时根据差值 (1.0 – 0.7 = 0.3)由右至左调整每个权重Wi及偏置值bi。同样的步骤再输入第二组数据进行调整,直到所有训练数据都做过一轮。

图3. 神经网络:神经元工作原理

(图片来源:芮嘉玮绘制)

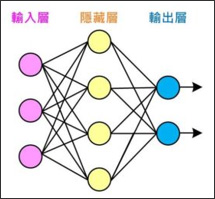

为了能处理更复杂的问题,一个神经元可扩展成一组简单 (单层) 神经网络,如图4所示,会有输入层、隐藏层 (Hidden Layer) 及输出层,推论和训练的概念与一个神经元大致相同。

图4. 简单(单层)神经网络[2]

图片来源https://makerpro.cc/2018/04/ai-chip-meets-maker-creativity-part-one/

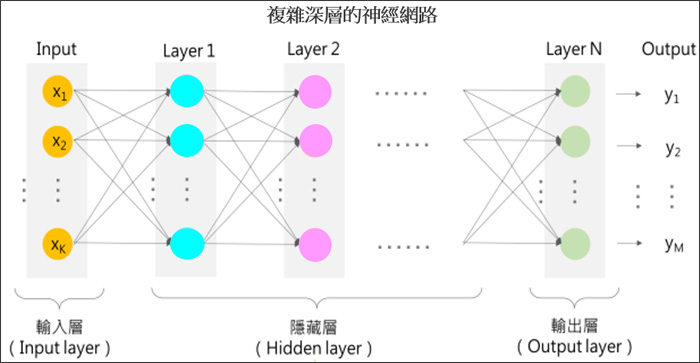

再者,待解决的问题如果更加困难,如图5所示,则可增加每一层的神经元或隐藏层数来解决,而形成复杂深层的神经网络,称之类神经网络模型,即所谓的深度学习。类神经网络模型,系由输入层 (Input layer)、隐藏层 (Hidden layer) 及输出层 (Output layer) 等三层所构成。类似于人脑内部会有大量称为「神经元」的神经细胞彼此相连。神经元按层组织,信号经历逐层传送从第一层 (即输入) 行进到最后层 (即输出)。类神经网络利用计算机模仿人类神经细胞接收讯息的结构和功能对讯息进行处理,然后将其发送给其他神经。神经网络中数以千计的处理节点负责定位图像、文本和语音等数据中的模式。这些模式协助算法确定下一步如何做,并教导自己如何透过每次成功执行任务做得更好。当一个神经元从其他神经元那里接收的电气信号量达某一定值以上,就会神经冲动(兴奋);在某一定值以下,就不会兴奋。兴奋起来的神经元,会将电器信号传送给下一个相连的神经元。下一个神经元同样会因此兴奋或不兴奋。也就是,彼此相连的神经元,会形成联合传递行为,透过将这种相连的结构来数学模型化,便形成了「类神经网络」[3]。因此,深度学习是一种以类似人类神经网络 (简称「类神经网络 (Neural Network)」) 的方式建构「多层神经网络」,让人工智能可以一层一层逐层学习,并进化到可以自我学习的阶段,且只要有充分的学习数据输入类神经网络,不需要人为的帮助它就能自行分析数据找出特征值。

图5. 深度学习:类神经网络模型

图片来源:https://meet.bnext.com.tw/blog/view/3220

由于深度学习是透过模仿人脑的「类神经网络」建构多层神经网络来逐层学习大量数据,并将其应用于解决问题的手法。神经网络模型可用于处理各种类型之资料。学习数据则是由输入数据以及相对应的正确解答所组成,而训练及机器学习可用以判定待藉由模型用于处理输入数据之一系数集,即神经网络模型之神经元之间的权重。以影像辨识为例,神经网络模型可经训练以辨识经接收输入影像内是否存在某些类型之对象,为了让AI学习类神经网络的模型,首先必须先将影像学习数据分割成像素数据,然后将各像素值输进输入层。接受了数据的输入层,将像素值乘上「权重」后,便传送给后方隐藏层的神经元。隐藏层的各个神经元会累加前一层所接收到的值,并将其结果再乘上「权重」后,传送给后方的神经元。最后,经由输出层的神经元的输出,便可得到影像辨识的预测结果。为了让输出层的值跟各个输入数据所对应的正解数据相等,会对各个神经元的输入计算出适当的「权重」值。这个权重的计算,一般是使用「误差倒传递算法」(Error Back Propagation),使用与正解数据之间的误差,从输出层逆推回去。透过各「权重」的调整,来缩小输出层的值与正解数据的值之间的误差,以建立出完成学习的模型。

2006年辛顿 (Geoffrey Hinton) 开发出自动编码器 (Autoencoder,简称自编码),利用以自动编码器所获得的类神经网络权重参数值进行初始化,应用在「误差倒传递算法」以提高多层类神经网络的学习准确度。即在类神经网络的输入层和输出层使用相同数据,并将隐藏层设置于二者之间,藉此用来调整类神经网络之间的权重参数,从而使深度学习成为一种只要将数据输入类神经网络便能自行抽出特征的人工智能,称之为「特征学习」(feature learning)。

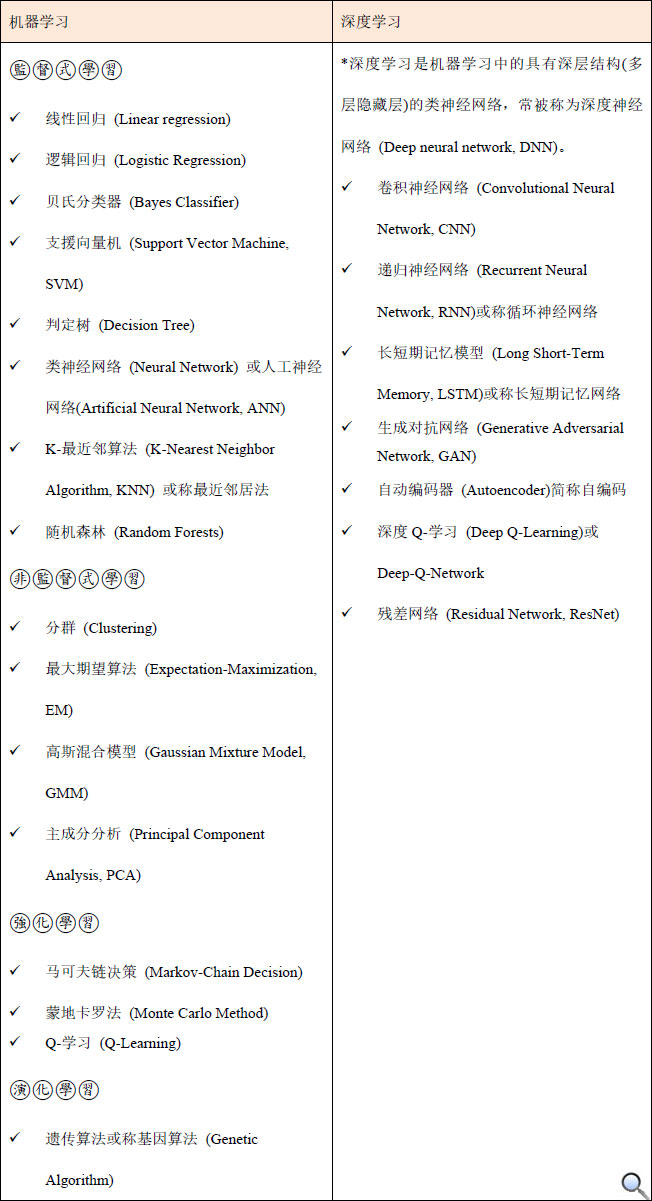

与机器学习不同,深度学习分类不容易根据学习方法或目标进行分类。Asoh等人将深度学习分为确定性模型 (deterministic model) 和概率模型 (probabilistic model)[4]。确定性模型中的代表性算法至少包括深度神经网络 (deep neural network)、递归神经网络 (recurrent neural network,RNN)、卷积神经网络 (convolution neural network,CNN)以及自动编码器 (autoencoder)。至于概率模型,通常使用受限玻尔兹曼机 (restricted boltzmann machine,RBM)、深度玻尔兹曼机 (Deep Boltzmann Machines,DBM) 和深度置信网 (deep belief network,DBN)。表1整理出AI机器学习和深度学习中常见之算法。

表1. 机器学习和深度学习常见的算法

整理制表:芮嘉玮

备注:

好消息~北美智权报有微信公众号了!

《北美智权报》内容涵盖世界各国的知识产权新闻、重要的侵权诉讼案例分析、法规解析,以及产业与技术新知等等。

立即关注北美智权微信公众号→ NAIP_IPServices

~欢迎读者分享与转发~ |

|

|

【本文只反映专家作者意见,不代表本报立场。】

|

|

| 作者: |

芮嘉玮 |

| 现任: |

工业技术研究院技术移转与法律中心执行长室 |

| 学历: |

台湾清华大学 奈米工程与微系统研究所 博士

中原大学 财经法律研究所 硕士

台湾科技大学 材料科学与工程研究所 硕士 |

| 经历: |

工研院电子与光电研究所专利副主委

光电产业智权经理 |

| 专长: |

创新技术策略分析、科技预测及评估、专利分析与布局、专利检索与专利分析实务、运用专利分析找出研发方向、产业分析与技术预测、知识产权管理与经营策略、专利申请实务、企业智财策略与专利布局、专利的商业化与货币化、系统化萃智(TRIZ)创新工程与管理 |

|

|

|